Der Boden verschiebt sich unter Ihren Füßen — und die meisten Unternehmen sehen es nicht kommen

Ein Kunde rief uns letzte Woche an. Sein organischer Traffic war in drei Monaten um 22% eingebrochen. Gutes Ranking, guter Content, keine sichtbare Penalty. Die Antwort war nicht in der Google Search Console.

Sie war woanders.

Dieser Fall ist kein Einzelfall. Im Jahr 2026 stehen Marketingleiter und KMU-Inhaber unter einem doppelten Druck, der nicht mit dem vergleichbar ist, was wir seit dem Mobile-Shift 2015 erlebt haben. Auf der einen Seite verfeinert Google weiterhin seine technischen Crawling-Regeln — stille Entwicklungen, die eine gut platzierte Website von einem Tag auf den anderen destabilisieren können. Auf der anderen Seite bauen ChatGPT und seine Konkurrenten einen neuen Entdeckungskanal auf, mit einem Cost-per-Click-Werbemodell, das auffallend an das erinnert, was Google AdWords 2003 war.

Zwei simultane Fronten. Zwei verschiedene Logiken. Ein einziges Budget.

So lesen Sie die Situation — und das können Sie konkret tun.

Was Google beim technischen Crawling ändert

Beginnen wir mit dem Grundlegenden. Bevor man an ChatGPT denkt, muss man sicherstellen, dass das Fundament solide ist.

Die robots.txt-Datei existiert seit 1994. Die meisten Webmaster haben sie einmal konfiguriert, vor Jahren, und nie wieder angefasst. Das ist ein Fehler, der 2026 teuer wird.

Google arbeitet seit mehreren Monaten an einer feineren und strengeren Interpretation der Crawling-Direktiven. Konkret bedeutet das, dass Regeln, die einst “toleriert” oder flexibel interpretiert wurden, nun buchstabengetreu angewendet werden können. Ganze Abschnitte einer Website — Kategorieseiten, Navigationsfilter, duplizierte Inhalte — können vom Crawling ausgeschlossen werden, ohne dass der Websitebetreiber sofort davon erfährt.

Was wir bei Audits unserer Kunden konkret sehen: zu weit gefasste Disallow-Direktiven, die ein Entwickler 2019 geschrieben hat und die heute strategische URLs blockieren. Oder umgekehrt: keine Einschränkungen für Tausende von internen Suchergebnisseiten, die das Crawl-Budget verwässern und wichtige Seiten verschwinden lassen.

Das Crawl-Budget, eben. Das ist das eigentliche Thema für Websites mit mehr als 500 Seiten. Wenn Sie genau verstehen wollen, wie Googlebot Ihre Website liest, gibt Ihnen unser Artikel darüber, was Google bei seiner Erkundung wirklich sieht, einen konkreten Rahmen. Google crawlt Ihre Website nicht in ihrer Gesamtheit bei jedem Besuch. Es wird ein Kontingent pro Domain zugewiesen, basierend auf der wahrgenommenen Autorität und der Reaktionsgeschwindigkeit des Servers. Wenn dieses Budget für wertlose Seiten verschwendet wird, werden Ihre strategischen Inhalte seltener gecrawlt — und langsamer indexiert.

Drei unmittelbare Wachsamkeitspunkte:

- Überprüfen Sie Ihre Server-Logs, um zu identifizieren, welche URLs Googlebot tatsächlich besucht

- Prüfen Sie Ihre

robots.txt, indem Sie jede Regel in der Google Search Console testen - Identifizieren Sie Seiten mit niedrigem Wert (Filter, URL-Parameter, Duplikate) und entscheiden Sie explizit, ob Sie diese ausschließen oder kanonisieren

Es ist nicht glamourös. Es gibt keine guten LinkedIn-Posts darüber. Aber es ist das, was eine Website, die wächst, von einer Website, die stagniert, trennt.

ChatGPT mit Werbung: verstehen, was wirklich passiert

Kommen wir zur zweiten Front — derjenigen, die Führungskräfte am meisten beunruhigt, oft aus den falschen Gründen.

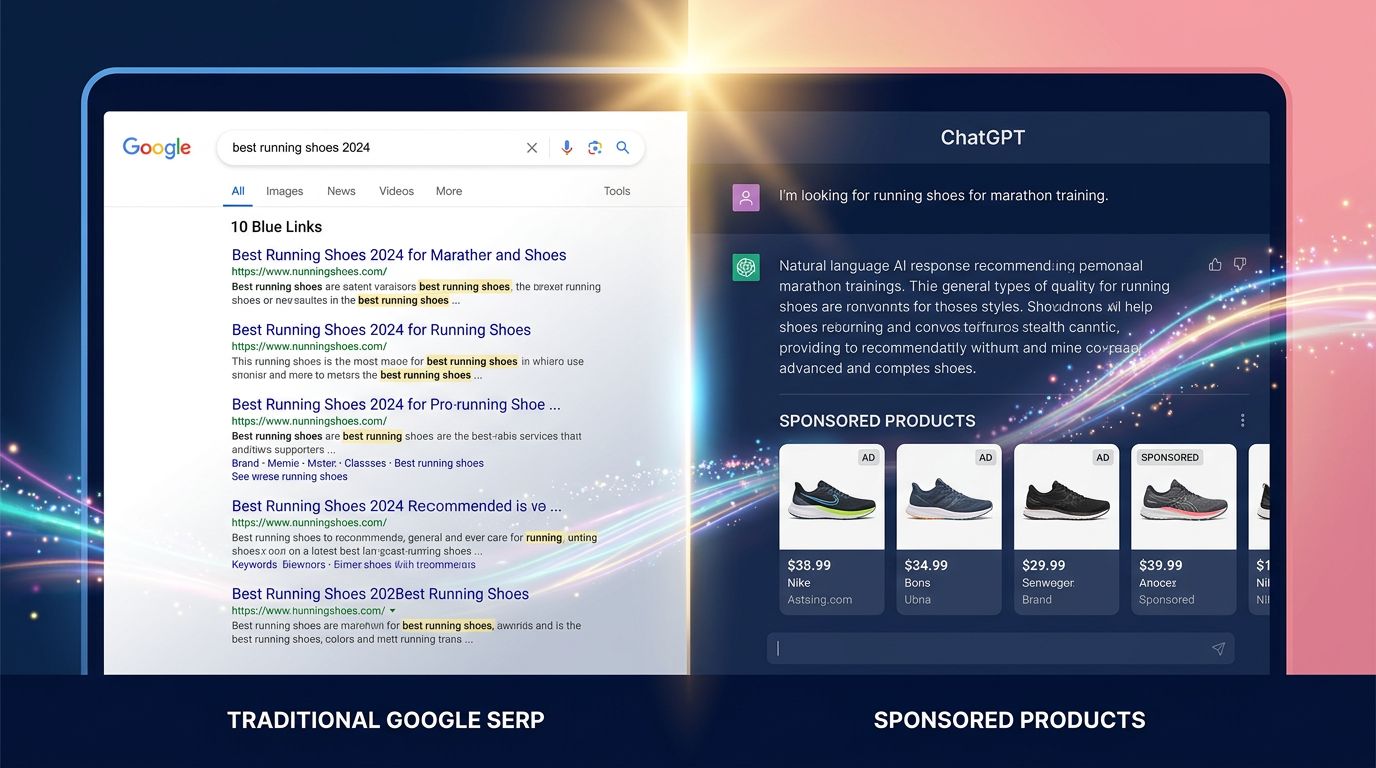

OpenAI hat die Einführung eines CPC (Cost-per-Click) Werbemodells in ChatGPT bestätigt. Für viele Beobachter ist es einfach eine Frage der Monetarisierung einer hochfrequentierten Plattform. Das stimmt. Aber das ist nicht der einzige Aspekt.

“Konversationelle Suchmaschinen ersetzen Google nicht — sie schaffen ein neues Suchverhalten, das neben Google existiert und einen Teil der Kaufabsichten abfängt.” — Analyse, die von mehreren SEO-Experten auf der BrightonSEO 2024 geteilt wurde.

Folgendes ändert sich grundlegend: Wenn ein Nutzer “beste Buchhaltungssoftware für Handwerker” in Google eingibt, sieht er Ergebnisse, klickt, vergleicht, kommt zurück. Der Weg ist nicht linear, aber der Traffic kommt auf den Websites an.

Wenn derselbe Nutzer dieselbe Frage an ChatGPT stellt, erhält er eine synthetisierte Antwort. Mit dem neuen Werbemodell kann diese Antwort gesponserte Links enthalten, die in das Gespräch integriert sind. Der Nutzer erhält eine kontextualisierte Empfehlung — und kann direkt auf ein Produkt oder eine Dienstleistung klicken, ohne je eine klassische Ergebnisseite zu besuchen.

Der Empfehlungsverkehr ändert seine Natur. Er wird konversationell, intentional und potenziell qualifizierter — aber er entzieht sich der Logik des traditionellen SEO.

Für ein KMU, das Produkte oder Dienstleistungen online verkauft, lautet die konkrete Frage: Ist Ihr Content so strukturiert, dass er von einer KI zitiert werden kann, und nicht nur von einer Suchmaschine indexiert?

Es ist nicht dasselbe.

Sichtbarkeit in KI-Systemen: Es ist kein SEO, aber es ähnelt ihm

Hier wird es interessant — und hier werden Ihnen viele Agenturen alles Mögliche erzählen.

Es gibt noch kein kodifiziertes und validiertes “SEO für ChatGPT”. Wer Ihnen eine Dienstleistung zur “LLM-Optimierung” mit Ergebnisgarantien verkauft, erzählt Ihnen eine Geschichte. Wir haben dieses Thema übrigens eingehend in unserem Artikel über die Zukunft von SEO angesichts der KI analysiert. Sprachmodelle funktionieren nicht wie Suchindizes. Sie haben keine Crawl-Datei, keine Meta-Tags, kein PageRank.

Was sie hingegen haben, ist eine Weltdarstellung, die aus Milliarden von Texten aufgebaut wurde. Und diese Darstellung begünstigt Quellen, die:

Von anderen zuverlässigen Quellen zitiert werden. Domain-Autorität bleibt relevant, nicht weil Google sie misst, sondern weil autoritative Seiten in den Trainingsdaten und in Echtzeit-Suchergebnissen, die einige Modelle konsultieren, überrepräsentiert sind.

Spezifische Fragen direkt beantworten. Inhalte, die im Q&A-Format strukturiert sind, mit klaren Definitionen und konkreten Beispielen, sind für ein Modell leichter extrahierbar.

Aktuell und regelmäßig aktualisiert sind. Modelle mit Echtzeit-Webzugang (wie ChatGPT mit aktivierter Navigation) bevorzugen frische Inhalte.

Was wir unseren Kunden derzeit empfehlen: ihre Google-SEO-Strategie nicht aufzugeben, um KI-Plattformen nachzujagen. Aber ihr redaktionelles Format anzupassen, damit ihre Expertise extrahierbar ist. Das bedeutet: direkte Antworten, klare Struktur, überprüfbare Daten, kein vager und generischer Content.

Was sich für Ihr Budget und Ihre Strategie ändert

Lassen Sie uns direkt über die praktischen Auswirkungen sprechen.

Wenn Sie ein KMU mit einem begrenzten digitalen Budget sind — sagen wir zwischen 500€ und 2.000€ pro Monat — können Sie nicht gleichzeitig auf allen Fronten kämpfen. Sie müssen wählen.

Unser Rat für ein Kleinunternehmen mit begrenztem Budget: Sichern Sie zunächst die technische Google-Basis, bevor Sie in KI-Sichtbarkeit investieren. Eine Website, die von Googlebot schlecht gecrawlt wird, wird von ChatGPT nicht besser behandelt. Das Fundament ist dasselbe.

Dann, wenn Sie einen E-Commerce oder ein lokales Unternehmen mit einer starken “Produktentdeckungs”-Komponente haben, beginnen Sie Ihre Analytics zu überwachen, um zu identifizieren, ob Sie bereits Traffic von ChatGPT oder anderen KI-Plattformen erhalten. Google Analytics 4 und einige Tools von Drittanbietern erlauben es nun, diese Quellen zu identifizieren. Es ist wahrscheinlich für die Mehrheit der deutschen KMUs noch nicht signifikant — aber es wird es werden.

Für Unternehmen mit einem bestehenden Werbebudget lohnt es sich, CPC auf ChatGPT zu testen, sobald es in Deutschland ausgerollt wird. Die Akquisitionskosten auf einer aufstrebenden Plattform sind historisch gesehen niedriger als auf einer reifen Plattform. Google Ads kostete 2003 einen Bruchteil dessen, was es heute kostet. Das Zeitfenster der Möglichkeit existiert — es wird nicht ewig bestehen.

Drei konkrete Maßnahmen, die Sie jetzt umsetzen sollten

Keine Theorie. Was wir tun würden, wenn wir an Ihrer Stelle wären, mit einer bestehenden Website und einem vernünftigen Budget.

1. Prüfen Sie Ihre robots.txt und Ihre Indexierungsabdeckung diese Woche. Öffnen Sie die Google Search Console, gehen Sie zu “URL-Prüfung” und testen Sie Ihre 10 wichtigsten Seiten. Überprüfen Sie, ob sie ordentlich indexiert sind, ob der Crawler sie nicht blockiert, und ob das Datum des letzten Crawls aktuell ist. Wenn das nicht der Fall ist, haben Sie ein technisches Prioritätsproblem — keine Content-Strategie wird das kompensieren.

2. Strukturieren Sie Ihre besten Inhalte im Format “direkte Antwort” um. Nehmen Sie Ihre 5 meistbesuchten Artikel oder Seiten. Fügen Sie in der Einleitung eine Antwort in 2-3 Sätzen auf die Hauptfrage hinzu. Strukturieren Sie den Inhalt mit Zwischenüberschriften, die selbst Fragen sind. Diese Arbeit dient sowohl Google Featured Snippets als auch der Extrahierbarkeit durch KI-Modelle. Doppelter Nutzen, einmaliger Aufwand.

3. Erstellen Sie ein Tracking-Dashboard für aufkommende Traffic-Quellen. Erstellen Sie in Google Analytics 4 ein benutzerdefiniertes Segment, um Traffic von chat.openai.com, perplexity.ai, claude.ai und anderen KI-Plattformen zu identifizieren. Auch wenn die Volumina heute marginal sind, wird es wertvoll sein, die historischen Daten zu haben, wenn diese Quellen bedeutsam werden, um Ihre zukünftigen Investitionen zu rechtfertigen.

Die wirkliche Frage für 2026

Wie viele Ihrer potenziellen Kunden haben ChatGPT bereits eine Frage gestellt, bevor sie auf Google gesucht haben? Sie wissen es nicht. Ich auch nicht. Niemand weiß es mit Sicherheit.

Aber wir wissen, dass das Suchverhalten sich fragmentiert. Wir wissen, dass Google nicht mehr der einzige Einstiegspunkt zu Ihrer Expertise ist. Und wir wissen, dass die Unternehmen, die ihre digitale Präsenz strukturiert haben, um auf diese Fragmentierung zu reagieren, einen Vorteil gegenüber denen haben werden, die auf definitive Zahlen gewartet haben.

Bei den Projekten, die wir derzeit bei GDM-Pixel durchführen, integrieren wir systematisch diese zwei Dimensionen in unsere SEO-Audits und Optimierungsleistungen: die technische Gesundheit für Google, und die Content-Strukturierung für die Lesbarkeit durch KI-Systeme. Das sind keine zwei getrennten Budgets — das ist eine einzige kohärente Strategie.

Wollen Sie wissen, wo Ihre Website auf diesen zwei Achsen steht? Wir bieten ein vollständiges technisches Audit in 3 Tagen an, mit einem umsetzbaren Bericht und nach Auswirkung priorisierten Empfehlungen. Kein 80-seitiger Bericht, der in der Schublade endet — ein Aktionsplan, den Sie die folgende Woche beginnen können umzusetzen.

Kontaktieren Sie GDM-Pixel für ein Audit — wir sagen Ihnen direkt, was Ihre Sichtbarkeit wirklich blockiert.

Verwendete Quellen: Google Search Central Dokumentation, BrightonSEO 2024 Analysen, FEVAD-Daten zum E-Commerce-Suchverhalten in Frankreich, OpenAI-Berichte zu ChatGPT-Monetarisierungsfunktionen.