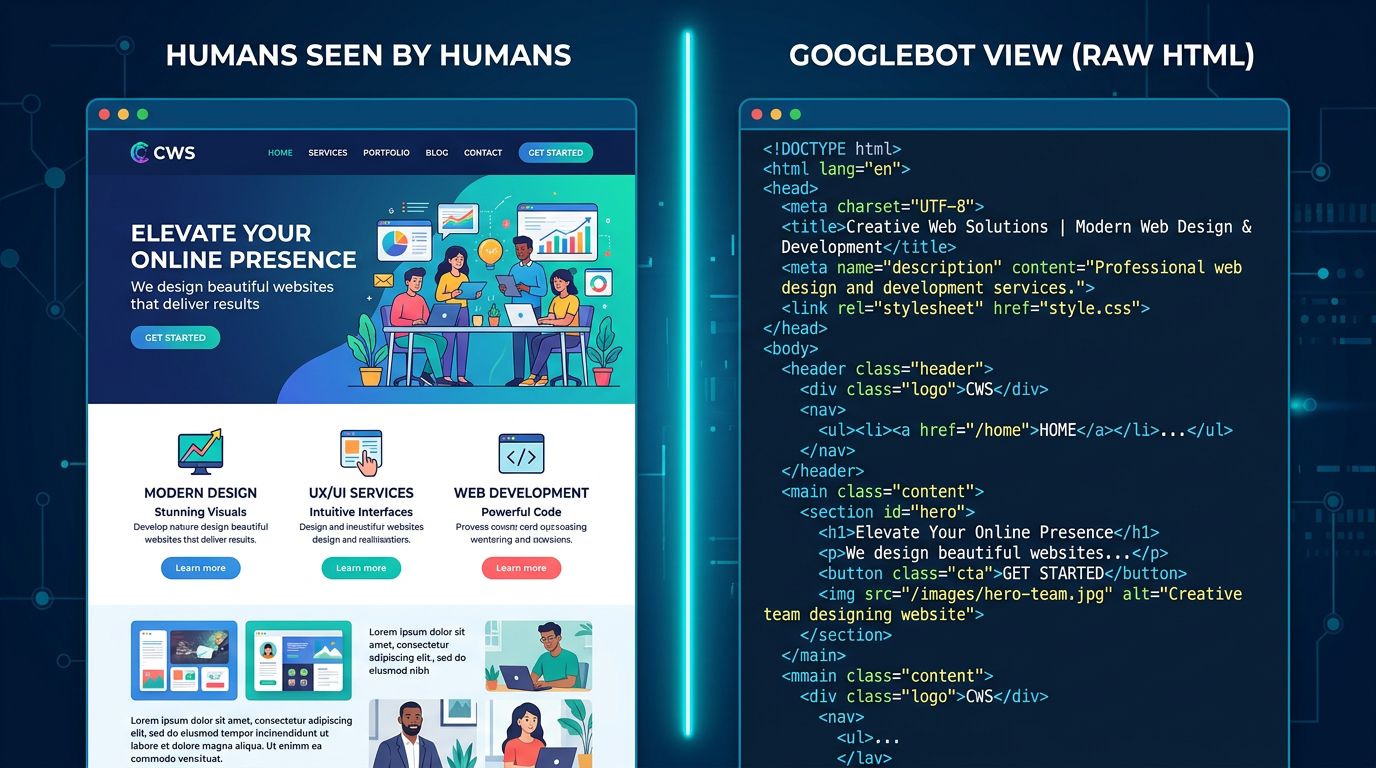

Un robot passe sur votre site toutes les quelques semaines. Il ne lit pas comme vous. Il ne “voit” pas vos images. Il ne comprend pas votre mise en page. Il analyse du code, il suit des signaux, il prend des décisions en quelques millisecondes — et ces décisions déterminent si votre contenu apparaît en page 1 ou nulle part.

La plupart des gérants de PME pensent que le référencement, c’est une question de mots-clés et de contenu. C’est vrai en partie. Mais il y a une couche en dessous que peu de gens voient : le dialogue technique entre votre site et Google. Un dialogue silencieux, avec ses propres règles, ses propres contraintes, ses propres malentendus.

Voici comment il fonctionne — et comment s’assurer que Google vous comprend correctement.

Comment Googlebot explore votre site (et pourquoi ça a des limites)

Googlebot n’est pas infini. C’est une chose que peu d’agences vous disent franchement.

Chaque site web reçoit ce qu’on appelle un “crawl budget” — une enveloppe de ressources que Google alloue pour explorer vos pages. Plus votre site est rapide, bien structuré et cohérent, plus Google en explore de pages lors de chaque passage. Plus votre site est lent, redondant ou confus, plus Google en rate.

Pour une TPE avec un site de 10 pages, ce n’est pas un problème critique. Mais pour une boutique PrestaShop avec 500 références, un site d’actualités avec 300 articles, ou un site multilingue — ça devient un enjeu réel.

Ce que Googlebot fait concrètement : il arrive sur une URL, télécharge le HTML, extrait les liens internes, les suit, et recommence. Il a une limite de temps par session, une limite de données par requête, et il priorise les pages qu’il considère “importantes” — en se basant sur les liens internes, la vitesse de réponse, et la fraîcheur du contenu.

Ce que ça signifie pour vous : si vous avez des pages orphelines (sans aucun lien interne qui y pointe), Googlebot ne les trouvera probablement jamais. Si votre serveur répond en 4 secondes, il explorera moins de pages à chaque visite. Si vous avez des centaines d’URLs générées automatiquement par des filtres ou des paramètres de tri — vous gaspillez son budget sur des pages sans valeur.

La règle de base : facilitez la vie de Googlebot. Chaque obstacle que vous lui imposez est une page de moins indexée.

Les balises canoniques : dire à Google quelle version de votre page est la bonne

Voici un scénario classique qu’on rencontre régulièrement chez nos clients e-commerce.

Une même page produit est accessible via trois URLs différentes :

monsite.fr/produit/chaussure-cuirmonsite.fr/produit/chaussure-cuir?couleur=marronmonsite.fr/produit/chaussure-cuir?tri=prix

Aux yeux de Google, ce sont trois pages distinctes. Trois pages avec un contenu quasi-identique. Résultat : contenu dupliqué, dilution du “jus SEO”, confusion sur quelle version positionner.

La balise canonique résout ce problème. Elle s’insère dans le <head> de votre page sous cette forme :

<link rel="canonical" href="https://monsite.fr/produit/chaussure-cuir" />Traduction pour Google : “Peu importe comment tu es arrivé sur cette page, la version de référence est celle-là.” C’est une directive claire, une convention établie que Google respecte dans l’immense majorité des cas.

“La balise canonique est l’un des signaux les plus sous-utilisés par les PME françaises. Elle ne coûte rien à implémenter et peut clarifier des situations de duplication qui plombent le référencement depuis des années.” — John Mueller, Google Search Relations

Ce qu’on voit concrètement chez nos clients : des sites PrestaShop ou WooCommerce qui génèrent automatiquement des dizaines de variantes d’URLs pour chaque produit, sans balises canoniques. Google indexe tout, se perd, et finit par ne positionner aucune version correctement.

La solution : implémenter les canoniques au niveau du CMS, une bonne fois pour toutes. Sur PrestaShop, c’est configurable nativement. Sur WordPress avec Yoast ou Rank Math, c’est automatique si bien configuré. Sur un site sur mesure, c’est 30 minutes de développement.

Les données structurées : parler le langage de Google

Il y a ce que vos visiteurs lisent. Et il y a ce que Google comprend.

Un humain voit “Ouvert du lundi au vendredi, 9h-18h, 02 31 XX XX XX” et comprend immédiatement que c’est un horaire et un numéro de téléphone. Google, lui, voit du texte brut. Il peut faire des suppositions — et il s’améliore — mais il peut aussi se tromper.

Les données structurées (schema.org) sont un langage balisé que vous injectez dans votre code HTML pour dire explicitement à Google : “ce texte, c’est une adresse”, “ce chiffre, c’est une note sur 5”, “cette date, c’est une date de publication”. Pas de supposition. Une information certaine.

Pourquoi c’est important ? Parce que les données structurées déclenchent des “rich snippets” — ces affichages enrichis dans les résultats Google qui montrent des étoiles, des prix, des FAQ, des événements. Et ces affichages enrichis améliorent le taux de clic, parfois de façon significative.

Quelques exemples concrets pour des PME normandes :

Pour un restaurant ou un hôtel

Le schéma LocalBusiness avec horaires, adresse, cuisine servie, gamme de prix. Google peut afficher directement ces infos dans les résultats — sans que l’utilisateur ait besoin de cliquer.

Pour un artisan ou un prestataire de services

Le schéma Service combiné à Review si vous avez des avis clients. Les étoiles dans les résultats de recherche attirent l’œil immédiatement.

Pour un site de contenu ou un blog

Le schéma Article avec date de publication, auteur, image principale. Google comprend mieux la fraîcheur de votre contenu — un signal de qualité pour les sujets d’actualité.

Pour une boutique en ligne

Le schéma Product avec prix, disponibilité, avis. Vos produits peuvent apparaître directement dans Google Shopping sans campagne payante.

L’implémentation technique se fait soit via JSON-LD (recommandé par Google — un bloc de code dans le <head> ou en bas de page), soit via des balises microdata directement dans le HTML. Le JSON-LD est plus propre et plus maintenable.

Les erreurs silencieuses qui sabotent votre dialogue avec Google

Après 15 ans d’audits techniques, certains problèmes reviennent systématiquement. Ils sont invisibles pour le visiteur humain. Ils sont catastrophiques pour le référencement.

Les redirections en chaîne. Votre ancienne URL redirige vers une deuxième URL qui redirige vers une troisième. Chaque saut coûte du crawl budget et dilue la transmission de signal SEO. Règle simple : une redirection directe, point.

Le contenu bloqué dans le JavaScript. Si votre contenu principal est chargé via JavaScript et que votre serveur ne le rend pas côté serveur (SSR), Googlebot peut ne jamais le voir. Il voit une page vide. C’est un problème fréquent avec certains frameworks modernes mal configurés.

Les pages en noindex par erreur. On a vu des sites entiers en production avec une balise <meta name="robots" content="noindex"> oubliée depuis la phase de développement. Résultat : zéro page indexée. Zéro trafic. Et personne ne s’en rend compte pendant des mois.

Le sitemap XML obsolète. Votre sitemap liste des pages qui n’existent plus, des URLs en 404, des pages canonisées ailleurs. Google perd du temps à explorer des impasses. Un sitemap propre = un budget crawl mieux utilisé.

“Un audit technique n’est pas un luxe réservé aux grands sites. C’est un diagnostic de base que tout site devrait faire au moins une fois par an.” — Gary Illyes, Google

Ces erreurs ne font pas de bruit. Votre site continue de fonctionner normalement pour vos visiteurs. Mais dans le dialogue silencieux avec Google, vous envoyez des signaux contradictoires ou parasites — et Google en tire ses propres conclusions.

Ce que vous pouvez vérifier vous-même aujourd’hui

Pas besoin d’un développeur pour commencer. Trois vérifications rapides :

1. Testez votre site dans Google Search Console. Si vous n’avez pas encore de compte Search Console lié à votre site, c’est la première chose à faire. Gratuit, officiel, et il vous dit exactement quelles pages Google a indexées, quelles erreurs il a rencontrées, et comment votre site se comporte dans les résultats.

2. Vérifiez votre balise canonique sur les pages importantes. Sur votre page d’accueil, faites Clic droit > Afficher la source de la page, puis cherchez “canonical”. Vous devriez voir une URL qui correspond exactement à votre adresse principale. Si vous voyez une URL bizarre ou rien du tout, c’est à corriger.

3. Testez vos données structurées. Google propose un outil gratuit : le Validateur de résultats enrichis. Entrez votre URL, et il vous dit si des données structurées sont détectées, et si elles sont valides.

Ces trois vérifications prennent 20 minutes. Elles peuvent révéler des problèmes qui existent depuis des années.

Le dialogue technique, ça s’entretient

Un site web n’est pas un panneau publicitaire qu’on plante et qu’on oublie. C’est un interlocuteur permanent avec Google — un dialogue qui évolue au rythme des mises à jour de votre contenu, des changements d’algorithme, et des évolutions de votre structure.

Ce dialogue a ses propres règles. Respectez le budget crawl. Soyez précis sur vos canoniques. Parlez le langage des données structurées. Éliminez les erreurs silencieuses.

Ce n’est pas du SEO avancé réservé aux grandes entreprises. C’est de la maintenance de base que tout site professionnel devrait assurer.

La différence entre un site qu’on trouve et un site qu’on ne trouve pas tient souvent à ces détails techniques — pas à la qualité du contenu, pas au design, pas au budget publicitaire. Juste à la capacité de votre site à parler correctement à Google.

Vous voulez savoir ce que Google voit réellement sur votre site ?

Chez GDM-Pixel, on fait des audits techniques complets — crawl budget, canoniques, données structurées, erreurs silencieuses. Pas pour vendre une refonte. Pour vous dire exactement où sont les problèmes et ce qui mérite d’être corrigé en priorité.

Parfois c’est 2 heures de travail. Parfois c’est plus. Mais on ne vous vend pas ce dont vous n’avez pas besoin.

Contactez-nous pour un diagnostic honnête. On vous dit ce qu’on trouve — même si la réponse c’est “votre site va bien, continuez comme ça.”

À retenir

- Googlebot a des limites : un site mal structuré gaspille son budget crawl et rate des indexations importantes

- Les balises canoniques sont indispensables dès que vous avez des URLs dynamiques ou du contenu dupliqué

- Les données structurées ne sont pas optionnelles si vous voulez des résultats enrichis — et elles sont accessibles à n’importe quelle PME

GDM-Pixel — Agence web à Caen. On construit des sites qui parlent correctement à Google.