Google durcit les règles — et la plupart des sites ne sont pas prêts

Un client nous a appelé il y a quelques semaines, affolé. Son trafic organique avait chuté de 30% en deux mois. Pas de pénalité manuelle. Pas de contenu dupliqué. Juste un fichier robots.txt mal configuré et des fiches produits invisibles dans Google Shopping.

Résultat : des centaines de pages crawlées inutilement, et ses vraies pages produits ignorées par Google.

Ce scénario, on le voit de plus en plus souvent. Google n’est plus indulgent sur la précision technique. Les règles de crawl évoluent, les exigences sur les données structurées se resserrent, et un nouveau rapport dans Google Search Console vient de changer la donne pour les e-commerçants.

La question n’est plus “est-ce que Google m’indexe ?” mais “est-ce que Google indexe ce que je veux, comme je le veux ?”

Robots.txt : ce que Google va changer — et pourquoi ça compte vraiment

Le fichier robots.txt, c’est votre portier. Vous dites à Googlebot ce qu’il peut crawler, ce qu’il ne peut pas. Simple en théorie. Complexe en pratique.

Google a annoncé des changements dans l’interprétation des directives robots.txt. L’objectif : plus de précision, moins de place à l’ambiguïté. Concrètement, certaines directives qui étaient “tolérées” même mal écrites vont être interprétées de façon plus stricte.

Ce que ça signifie pour votre site :

Les directives contradictoires vont poser problème. Si vous avez un Disallow: / suivi d’un Allow: /blog/ dans le même bloc, Google va désormais appliquer une logique de priorité plus rigoureuse. Une règle mal ordonnée peut bloquer des sections entières de votre site.

Les wildcards mal utilisés vont coûter cher. Les patterns comme Disallow: /*? (bloquer toutes les URLs avec paramètres) sont fréquents. Mais si vos URLs de filtres e-commerce utilisent des paramètres légitimes pour des pages importantes, vous venez de les effacer du radar de Google.

L’héritage des configurations “par défaut” devient risqué. Beaucoup de sites tournent avec un robots.txt généré automatiquement par WordPress, PrestaShop ou un thème il y a 5 ans. Personne ne l’a touché depuis. Ces fichiers contiennent souvent des blocages résiduels qui n’ont plus de raison d’être.

Après 15 ans d’audits techniques, le constat est toujours le même : le robots.txt est le fichier le plus négligé des sites web. Et c’est souvent là que se cachent les pertes de trafic inexpliquées. Pour aller plus loin sur ce que Google lit réellement quand il visite votre site, lisez notre article sur ce que Google voit vraiment lors de son exploration.

Comment auditer votre robots.txt maintenant

Pas besoin d’outil complexe pour commencer. Google Search Console intègre un testeur de robots.txt dans la section “Outils d’inspection”. Vous entrez une URL, il vous dit si elle est bloquée ou non.

Ce que vous devez vérifier en priorité :

- Vos pages produits et catégories sont-elles crawlables ?

- Vos URLs avec paramètres de tri/filtres sont-elles correctement gérées ?

- Vos ressources CSS et JavaScript sont-elles accessibles ? (Google a besoin de les lire pour comprendre votre design)

- Votre sitemap est-il déclaré en fin de fichier ?

Un audit honnête prend 2 heures sur un site standard. Sur un e-commerce avec 5 000 références, comptez une journée.

Le nouveau rapport “Fiches Produits” dans Google Search Console : ce que ça change pour les e-commerçants

C’est la vraie nouveauté qui devrait faire réagir tous les propriétaires de boutiques en ligne.

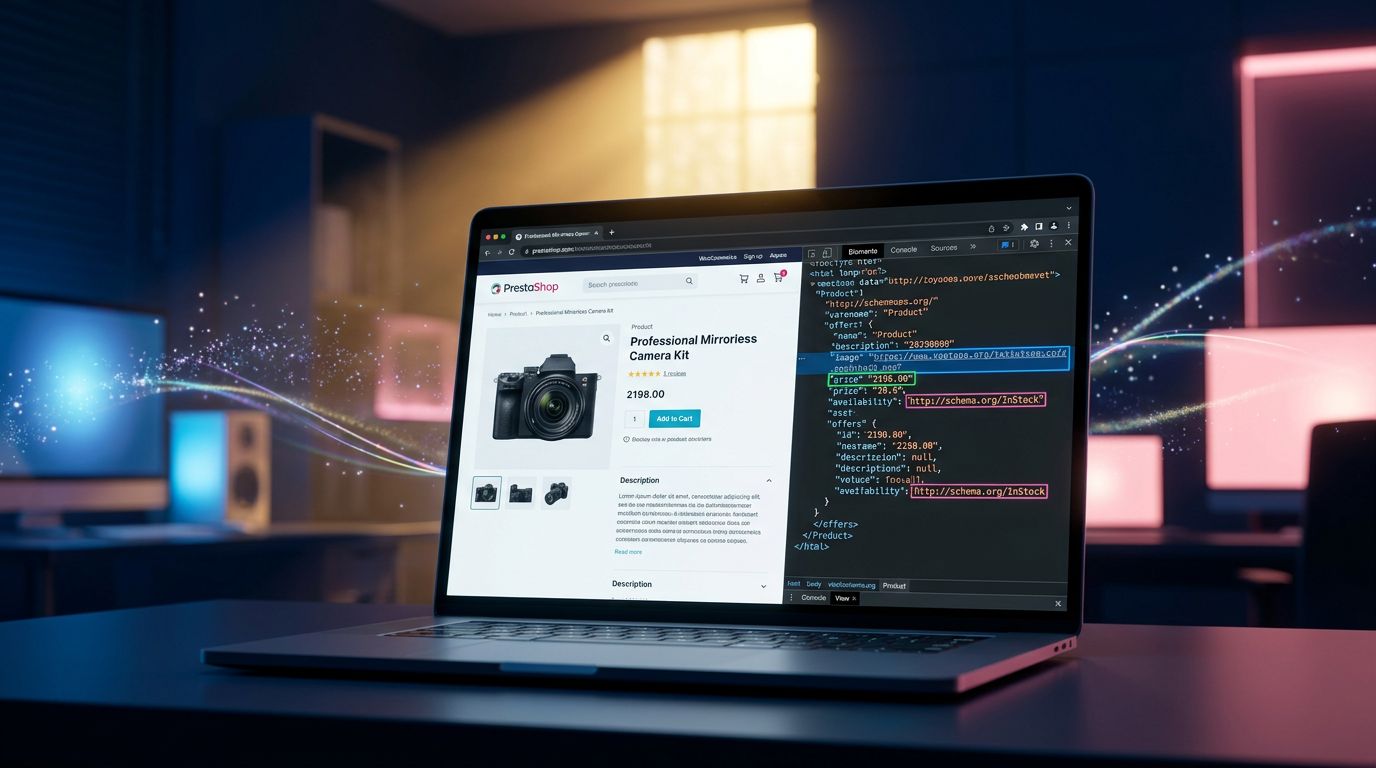

Google a déployé un rapport dédié aux Merchant Listings — les fiches produits enrichies qui apparaissent dans Google Shopping, les résultats de recherche avec prix et disponibilité, et les panneaux de connaissances produits. Ce rapport est maintenant accessible directement dans Search Console, avec un niveau de détail inédit.

“Les données structurées sont la langue que vous utilisez pour parler directement à Google. Si votre grammaire est mauvaise, Google ne comprend pas — et vos produits n’apparaissent pas.”

Concrètement, ce rapport vous donne :

La couverture réelle de vos fiches produits. Combien de vos produits sont éligibles à l’affichage enrichi ? Combien sont effectivement affichés ? L’écart entre les deux, c’est votre marge de progression immédiate.

Les erreurs de données structurées par type. Prix manquant, disponibilité non renseignée, image non conforme aux standards Google — chaque erreur est catégorisée. Vous savez exactement quoi corriger, dans quel ordre.

La distinction entre erreurs bloquantes et avertissements. Une erreur bloquante = votre fiche n’apparaît pas. Un avertissement = elle apparaît, mais sous-optimisée. La nuance est importante pour prioriser vos actions.

Les erreurs les plus fréquentes qu’on voit sur les boutiques normandes

Sur les e-commerces qu’on audite régulièrement, trois problèmes reviennent systématiquement :

1. Le prix absent ou mal formaté

Google exige un prix avec devise explicite dans le balisage Schema.org. "price": "29.90" sans "priceCurrency": "EUR" ? Fiche invalide. C’est une erreur bête, mais elle concerne facilement 20 à 30% des produits sur les boutiques montées rapidement.

2. La disponibilité jamais mise à jour

Le champ availability dans Schema.org doit refléter l’état réel du stock. Un produit marqué InStock alors qu’il est en rupture depuis 3 semaines ? Google le détecte, dégrade votre fiche, et peut pénaliser la confiance globale accordée à votre domaine.

3. Les images non conformes

Google Shopping a des exigences précises : image principale sur fond blanc ou neutre, minimum 250x250 pixels, pas de texte promotionnel superposé. Beaucoup de boutiques utilisent leurs images “marketing” avec bandeau “PROMO -20%” — et se retrouvent avec des fiches bloquées sans comprendre pourquoi.

Données structurées : l’investissement technique qui rentabilise vraiment

Voilà où ça devient intéressant.

Les données structurées ne sont pas un détail technique réservé aux grandes enseignes. C’est le levier le plus sous-exploité par les PME e-commerce. Et le rapport Merchant Listings de Search Console vient de rendre cet investissement beaucoup plus mesurable.

Avant ce rapport, vous saviez vaguement si vos produits apparaissaient dans Google Shopping. Maintenant, vous avez les données produit par produit, erreur par erreur. C’est la différence entre “je pense que mon balisage est correct” et “Google me dit exactement ce qui cloche sur 47 de mes 312 produits”.

Ce qu’on a constaté sur les projets récents : corriger les erreurs de données structurées sur une boutique PrestaShop de taille moyenne génère en moyenne 15 à 25% d’impressions supplémentaires dans les résultats enrichis dans les 6 à 8 semaines suivantes. Pas de magie — juste de la précision technique. Ces optimisations s’inscrivent dans une démarche globale de référencement naturel que nous mettons en place pour nos clients.

“Le SEO en 2026, c’est 40% de contenu et 60% de précision technique. La plupart des agences vendent le contenu et bâclent la technique.”

La mise en place correcte du balisage Schema.org Product avec tous les champs requis (nom, description, prix, devise, disponibilité, image, marque, GTIN si disponible) prend entre 1 et 3 jours selon la complexité de votre catalogue et votre plateforme. Sur PrestaShop, des modules existent. Sur WooCommerce également. Mais leur configuration par défaut est rarement optimale — il faut les vérifier et les ajuster.

Ce que ça implique concrètement pour votre stratégie SEO

Ces deux évolutions — la rigueur accrue sur robots.txt et le nouveau rapport Merchant Listings — pointent vers la même direction.

Google veut de la précision. Pas de l’approximation.

Les sites qui vont en bénéficier sont ceux qui traitent la technique SEO comme un chantier continu, pas comme une case à cocher une fois par an. Voici ce que ça implique concrètement :

Un audit robots.txt au minimum une fois par an, et à chaque refonte ou migration. C’est 2 heures de travail qui peuvent éviter des mois de perte de trafic.

Une surveillance mensuelle du rapport Merchant Listings si vous avez une boutique en ligne. Les erreurs s’accumulent progressivement — nouveau produit mal configuré, mise à jour de plugin qui casse le balisage, changement de stock non répercuté. Un œil régulier suffit à les corriger avant qu’elles impactent votre visibilité.

Un balisage Schema.org maintenu, pas juste installé. L’erreur classique : on installe un plugin de données structurées, on valide une fois sur Google Rich Results Test, et on n’y touche plus. Sauf que le catalogue évolue, les prix changent, les stocks bougent. Le balisage doit suivre.

Une coordination entre votre équipe technique et votre équipe marketing. Combien de fois on voit des campagnes produits lancées sans que personne ait vérifié si les fiches correspondantes étaient correctement balisées ? Le rapport Merchant Listings doit devenir un outil partagé, pas un rapport technique isolé. Pour une vision complète des fondations SEO à maîtriser, notre guide du SEO technique détaille chaque couche à auditer.

3 actions à mettre en place cette semaine

Pas de liste interminable. Trois actions concrètes, dans l’ordre de priorité :

Action 1 — Testez votre robots.txt maintenant. Allez dans Google Search Console > Paramètres > Robots.txt. Testez vos 10 URLs les plus importantes. Si l’une d’elles est bloquée sans raison valable, c’est une urgence.

Action 2 — Ouvrez le rapport Merchant Listings si vous avez une boutique. Search Console > Expériences > Fiches Produits. Regardez votre taux de couverture et la liste des erreurs bloquantes. Si vous n’avez pas encore activé le suivi des données structurées produit, c’est le moment.

Action 3 — Validez votre balisage Schema.org sur 5 pages produits représentatives. Utilisez l’outil de test des résultats enrichis de Google. Cinq minutes par page. Vous saurez exactement où vous en êtes.

Conclusion : le SEO technique n’est plus optionnel

En Normandie comme partout en France, les PME e-commerce qui vont tirer leur épingle du jeu en 2026 ne seront pas forcément celles avec le plus gros budget publicitaire. Ce seront celles dont le site est techniquement irréprochable — parce que Google leur donne accès aux formats d’affichage enrichis que leurs concurrents ratent par négligence.

Le robots.txt, les données structurées, le rapport Merchant Listings : ce ne sont pas des sujets glamour. Mais ce sont des leviers mesurables, actionnables, avec un ROI documentable.

Chez GDM-Pixel, c’est exactement le type d’audit qu’on réalise avant de toucher à quoi que ce soit d’autre sur un site. Parce qu’on a appris à nos dépens qu’un beau site mal configuré techniquement, c’est un investissement qui dort.

Vous voulez savoir où en est votre site sur ces points ? On fait un diagnostic technique en 48h. Pas de rapport de 80 pages illisible — une liste d’actions priorisées avec l’impact estimé sur votre visibilité. Contactez-nous et on regarde ça ensemble.