Google verschärft die Regeln — und die meisten Websites sind nicht vorbereitet

Ein Kunde rief uns vor einigen Wochen an, völlig aufgelöst. Sein organischer Traffic war in zwei Monaten um 30% eingebrochen. Keine manuelle Penalty. Kein duplizierter Content. Nur eine falsch konfigurierte robots.txt-Datei und Produktseiten, die in Google Shopping unsichtbar waren.

Ergebnis: Hunderte nutzlos gecrawlter Seiten, und seine eigentlichen Produktseiten von Google ignoriert.

Dieses Szenario sehen wir immer häufiger. Google ist nicht mehr nachsichtig bei technischer Präzision. Die Crawling-Regeln entwickeln sich weiter, die Anforderungen an strukturierte Daten werden strenger, und ein neuer Bericht in der Google Search Console hat die Spielregeln für E-Commerce-Unternehmen gerade verändert.

Die Frage lautet nicht mehr “Indexiert Google mich?”, sondern “Indexiert Google das, was ich möchte, so wie ich es möchte?”

Robots.txt: Was Google ändern wird — und warum es wirklich wichtig ist

Die robots.txt-Datei ist Ihr Türsteher. Sie teilen Googlebot mit, was gecrawlt werden darf und was nicht. In der Theorie einfach. In der Praxis komplex.

Google hat Änderungen in der Interpretation von robots.txt-Direktiven angekündigt. Das Ziel: mehr Präzision, weniger Spielraum für Mehrdeutigkeiten. Konkret bedeutet das, dass einige Direktiven, die bisher “toleriert” wurden, auch wenn sie schlecht formuliert waren, nun strenger ausgelegt werden.

Was das für Ihre Website bedeutet:

Widersprüchliche Direktiven werden Probleme verursachen. Wenn Sie ein Disallow: / gefolgt von einem Allow: /blog/ im selben Block haben, wird Google nun eine strengere Prioritätslogik anwenden. Eine falsch geordnete Regel kann ganze Abschnitte Ihrer Website blockieren.

Falsch eingesetzte Wildcards werden teuer. Muster wie Disallow: /*? (alle URLs mit Parametern blockieren) sind häufig. Wenn Ihre E-Commerce-Filter-URLs jedoch legitime Parameter für wichtige Seiten verwenden, haben Sie diese gerade vom Radar Googles gelöscht.

Das Erbe von “Standard”-Konfigurationen wird riskant. Viele Websites laufen mit einer robots.txt, die vor 5 Jahren automatisch von WordPress, PrestaShop oder einem Theme generiert wurde. Niemand hat sie seitdem angefasst. Diese Dateien enthalten oft veraltete Blockierungen, die keinen Grund mehr haben zu existieren.

Nach 15 Jahren technischer Audits ist die Erkenntnis immer dieselbe: robots.txt ist die am meisten vernachlässigte Datei auf Websites. Und dort verbergen sich oft die unerklärlichen Trafficverluste. Um tiefer in das einzutauchen, was Google wirklich liest, wenn es Ihre Website besucht, lesen Sie unseren Artikel darüber, was Google bei seiner Erkundung wirklich sieht.

So auditieren Sie Ihre robots.txt jetzt

Für den Anfang ist kein komplexes Tool erforderlich. Google Search Console enthält einen robots.txt-Tester im Abschnitt “Inspektionstools”. Sie geben eine URL ein und erfahren, ob sie blockiert ist oder nicht.

Was Sie vorrangig überprüfen sollten:

- Sind Ihre Produkt- und Kategorieseiten crawlbar?

- Werden Ihre URLs mit Sortierungs-/Filterparametern korrekt behandelt?

- Sind Ihre CSS- und JavaScript-Ressourcen zugänglich? (Google muss sie lesen können, um Ihr Design zu verstehen)

- Ist Ihre Sitemap am Ende der Datei deklariert?

Ein ehrliches Audit dauert 2 Stunden bei einer Standard-Website. Bei einem E-Commerce mit 5.000 Artikeln rechnen Sie mit einem vollen Tag.

Der neue “Produktseiten”-Bericht in Google Search Console: Was sich für E-Commerce-Unternehmen ändert

Das ist die eigentliche Neuheit, auf die alle Online-Shop-Besitzer reagieren sollten.

Google hat einen dedizierten Bericht für Merchant Listings eingeführt — die angereicherten Produktseiten, die in Google Shopping, in Suchergebnissen mit Preis und Verfügbarkeit sowie in Produkt-Wissenspanels erscheinen. Dieser Bericht ist nun direkt in der Search Console zugänglich, mit einem beispiellosen Detaillierungsgrad.

“Strukturierte Daten sind die Sprache, mit der Sie direkt mit Google kommunizieren. Wenn Ihre Grammatik schlecht ist, versteht Google nicht — und Ihre Produkte erscheinen nicht.”

Konkret gibt Ihnen dieser Bericht:

Die tatsächliche Abdeckung Ihrer Produktseiten. Wie viele Ihrer Produkte sind für die angereicherte Anzeige geeignet? Wie viele werden tatsächlich angezeigt? Die Lücke zwischen beiden ist Ihr unmittelbares Verbesserungspotenzial.

Fehler in strukturierten Daten nach Typ. Fehlender Preis, nicht angegebene Verfügbarkeit, Bild nicht den Google-Standards entsprechend — jeder Fehler ist kategorisiert. Sie wissen genau, was in welcher Reihenfolge zu korrigieren ist.

Die Unterscheidung zwischen blockierenden Fehlern und Warnungen. Ein blockierender Fehler = Ihre Seite erscheint nicht. Eine Warnung = sie erscheint, aber sub-optimal. Der Unterschied ist wichtig für die Priorisierung Ihrer Maßnahmen.

Die häufigsten Fehler, die wir in Online-Shops sehen

Bei den E-Commerce-Websites, die wir regelmäßig auditieren, tauchen drei Probleme systematisch auf:

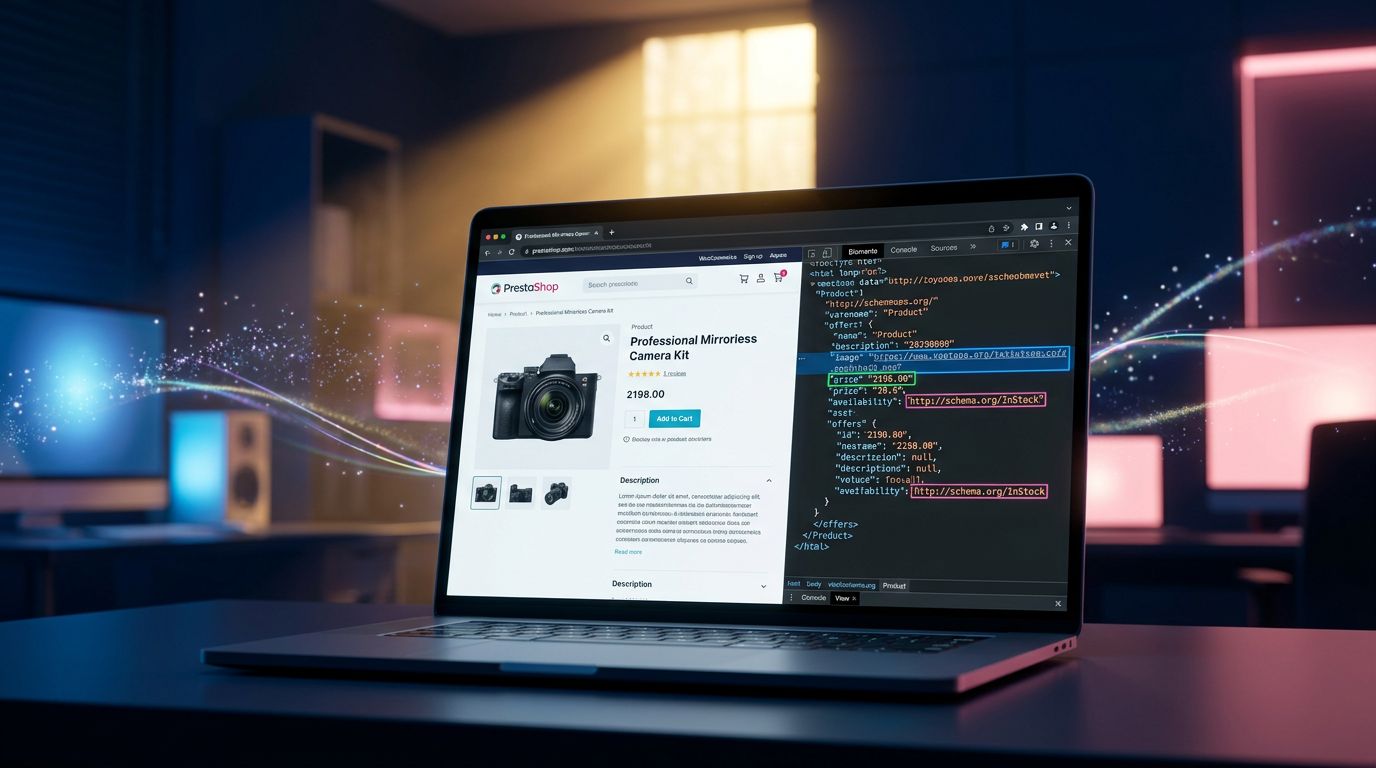

1. Der fehlende oder falsch formatierte Preis

Google erfordert einen Preis mit expliziter Währung im Schema.org-Markup. "price": "29.90" ohne "priceCurrency": "EUR"? Ungültige Seite. Das ist ein dummer Fehler, der aber leicht 20 bis 30% der Produkte in schnell aufgebauten Shops betrifft.

2. Die nie aktualisierte Verfügbarkeit

Das Feld availability in Schema.org muss den tatsächlichen Lagerbestand widerspiegeln. Ein als InStock markiertes Produkt, das seit 3 Wochen ausverkauft ist? Google erkennt es, stuft Ihre Seite herab und kann das allgemeine Vertrauen in Ihre Domain beeinträchtigen.

3. Nicht konforme Bilder

Google Shopping hat genaue Anforderungen: Hauptbild auf weißem oder neutralem Hintergrund, mindestens 250x250 Pixel, kein überlagerter Werbetext. Viele Shops verwenden ihre “Marketing”-Bilder mit “ANGEBOT -20%“-Banner — und haben dann blockierte Seiten, ohne zu verstehen warum.

Strukturierte Daten: Die technische Investition, die sich wirklich lohnt

Hier wird es interessant.

Strukturierte Daten sind kein technisches Detail, das großen Unternehmen vorbehalten ist. Sie sind der am meisten untergenutzte Hebel für KMUs im E-Commerce. Und der Merchant Listings-Bericht in der Search Console hat diese Investition gerade viel messbarer gemacht.

Vor diesem Bericht hatten Sie eine vage Vorstellung davon, ob Ihre Produkte in Google Shopping erschienen. Jetzt haben Sie Daten Produkt für Produkt, Fehler für Fehler. Das ist der Unterschied zwischen “Ich glaube, mein Markup ist korrekt” und “Google sagt mir genau, was mit 47 meiner 312 Produkte nicht stimmt”.

Was wir bei aktuellen Projekten beobachtet haben: Die Korrektur von Fehlern in strukturierten Daten bei einem mittelgroßen PrestaShop-Shop generiert im Durchschnitt 15 bis 25% zusätzliche Impressionen in angereicherten Ergebnissen in den folgenden 6 bis 8 Wochen. Kein Zauber — nur technische Präzision. Diese Optimierungen sind Teil eines ganzheitlichen Ansatzes zur Suchmaschinenoptimierung, den wir für unsere Kunden umsetzen.

“SEO im Jahr 2026 ist zu 40% Content und zu 60% technische Präzision. Die meisten Agenturen verkaufen Content und vernachlässigen die Technik.”

Die korrekte Implementierung des Schema.org Product-Markups mit allen erforderlichen Feldern (Name, Beschreibung, Preis, Währung, Verfügbarkeit, Bild, Marke, GTIN falls vorhanden) dauert je nach Komplexität Ihres Katalogs und Ihrer Plattform 1 bis 3 Tage. Für PrestaShop gibt es Module. Für WooCommerce ebenfalls. Aber deren Standardkonfiguration ist selten optimal — sie muss überprüft und angepasst werden.

Was das konkret für Ihre SEO-Strategie bedeutet

Diese beiden Entwicklungen — die erhöhte Strenge bei robots.txt und der neue Merchant Listings-Bericht — weisen in dieselbe Richtung.

Google will Präzision. Nicht Annäherung.

Die Websites, die davon profitieren werden, sind diejenigen, die technisches SEO als kontinuierliches Projekt behandeln, nicht als einmalige Aufgabe. Das bedeutet konkret:

Ein robots.txt-Audit mindestens einmal im Jahr, und bei jedem Relaunch oder jeder Migration. Das sind 2 Stunden Arbeit, die monatelange Trafficverluste verhindern können.

Monatliche Überwachung des Merchant Listings-Berichts, wenn Sie einen Online-Shop haben. Fehler häufen sich schrittweise an — ein neues, schlecht konfiguriertes Produkt, ein Plugin-Update, das das Markup kaputt macht, eine Lagerveränderung, die nicht übertragen wurde. Eine regelmäßige Überprüfung reicht aus, um sie zu korrigieren, bevor sie Ihre Sichtbarkeit beeinträchtigen.

Schema.org-Markup pflegen, nicht nur installieren. Der klassische Fehler: Sie installieren ein Structured Data Plugin, validieren es einmal im Google Rich Results Test und rühren es nie wieder an. Dabei entwickelt sich der Katalog weiter, Preise ändern sich, Lagerbestände bewegen sich. Das Markup muss mithalten.

Koordination zwischen Ihrem technischen Team und Ihrem Marketing-Team. Wie oft sehen wir Produktkampagnen starten, ohne dass jemand überprüft hat, ob die entsprechenden Seiten korrekt ausgezeichnet sind? Der Merchant Listings-Bericht muss zu einem gemeinsam genutzten Tool werden, nicht zu einem isolierten technischen Bericht. Für einen vollständigen Überblick über die SEO-Grundlagen, die beherrscht werden müssen, beschreibt unser technischer SEO-Leitfaden jede Ebene, die auditiert werden sollte.

3 Maßnahmen für diese Woche

Keine endlose Liste. Drei konkrete Maßnahmen in der Reihenfolge ihrer Priorität:

Maßnahme 1 — Testen Sie jetzt Ihre robots.txt. Gehen Sie in der Google Search Console zu > Einstellungen > Robots.txt. Testen Sie Ihre 10 wichtigsten URLs. Wenn eine davon ohne triftigen Grund blockiert ist, ist das dringend.

Maßnahme 2 — Öffnen Sie den Merchant Listings-Bericht, wenn Sie einen Shop haben. Search Console > Erlebnisse > Produktseiten. Schauen Sie sich Ihre Abdeckungsrate und die Liste der blockierenden Fehler an. Wenn Sie das Tracking für strukturierte Produktdaten noch nicht aktiviert haben, ist jetzt der richtige Zeitpunkt.

Maßnahme 3 — Validieren Sie Ihr Schema.org-Markup auf 5 repräsentativen Produktseiten. Nutzen Sie das Google-Tool zum Testen von Rich-Suchergebnissen. Fünf Minuten pro Seite. Sie wissen dann genau, wo Sie stehen.

Fazit: Technisches SEO ist nicht mehr optional

E-Commerce-KMUs, die sich 2026 durchsetzen werden, sind nicht unbedingt diejenigen mit dem größten Werbebudget. Es werden diejenigen sein, deren Website technisch einwandfrei ist — weil Google ihnen Zugang zu angereicherten Anzeigeformaten gewährt, die ihre Wettbewerber durch Nachlässigkeit verpassen.

robots.txt, strukturierte Daten, der Merchant Listings-Bericht: Das sind keine glamourösen Themen. Aber es sind messbare, handlungsfähige Hebel mit einem dokumentierbaren ROI.

Bei GDM-Pixel ist das genau die Art von Audit, die wir durchführen, bevor wir irgendetwas anderes an einer Website anfassen. Denn wir haben aus eigener Erfahrung gelernt, dass eine schöne, aber technisch schlecht konfigurierte Website eine schlafende Investition ist.

Wollen Sie wissen, wie Ihre Website bei diesen Punkten dasteht? Wir erstellen in 48 Stunden eine technische Diagnose. Kein unlesbarer 80-seitiger Bericht — eine priorisierte Aktionsliste mit der geschätzten Auswirkung auf Ihre Sichtbarkeit. Kontaktieren Sie uns und wir schauen es uns gemeinsam an.