Google inasprisce le regole — e la maggior parte dei siti non è pronta

Un cliente ci ha chiamato qualche settimana fa, in preda al panico. Il suo traffico organico era crollato del 30% in due mesi. Nessuna penalizzazione manuale. Nessun contenuto duplicato. Solo un file robots.txt mal configurato e schede prodotto invisibili su Google Shopping.

Risultato: centinaia di pagine scansionate inutilmente, e le sue vere pagine prodotto ignorate da Google.

Questo scenario lo vediamo sempre più spesso. Google non è più indulgente sulla precisione tecnica. Le regole di scansione evolvono, i requisiti sui dati strutturati si stringono, e un nuovo report in Google Search Console ha appena cambiato le regole del gioco per i negozi e-commerce.

La domanda non è più “Google mi sta indicizzando?” ma “Google sta indicizzando quello che voglio, come lo voglio?”

Robots.txt: cosa sta cambiando Google — e perché conta davvero

Il file robots.txt è il tuo portiere. Dici a Googlebot cosa può scansionare e cosa no. Semplice in teoria. Complesso in pratica.

Google ha annunciato cambiamenti nell’interpretazione delle direttive robots.txt. L’obiettivo: più precisione, meno spazio all’ambiguità. Concretamente, alcune direttive che erano “tollerate” anche se mal scritte verranno ora interpretate in modo più rigoroso.

Cosa significa per il tuo sito:

Le direttive contraddittorie causeranno problemi. Se hai un Disallow: / seguito da un Allow: /blog/ nello stesso blocco, Google applicherà ora una logica di priorità più rigorosa. Una regola mal ordinata può bloccare intere sezioni del tuo sito.

I wildcard mal utilizzati costeranno caro. I pattern come Disallow: /*? (bloccare tutti gli URL con parametri) sono frequenti. Ma se gli URL dei tuoi filtri e-commerce utilizzano parametri legittimi per pagine importanti, li hai appena cancellati dal radar di Google.

L’eredità delle configurazioni “predefinite” diventa rischiosa. Molti siti funzionano con un robots.txt generato automaticamente da WordPress, PrestaShop o un tema 5 anni fa. Nessuno lo ha toccato da allora. Questi file contengono spesso blocchi residui che non hanno più ragione di esistere.

Dopo 15 anni di audit tecnici, il quadro è sempre lo stesso: robots.txt è il file più trascurato dei siti web. Ed è spesso lì che si nascondono le perdite di traffico inspiegabili. Per approfondire ciò che Google legge davvero quando visita il tuo sito, leggi il nostro articolo su cosa vede davvero Google durante la sua esplorazione.

Come effettuare un audit del tuo robots.txt adesso

Non serve uno strumento complesso per cominciare. Google Search Console integra un tester di robots.txt nella sezione “Strumenti di ispezione”. Inserisci un URL e ti dice se è bloccato o meno.

Cosa devi verificare in priorità:

- Le tue pagine prodotto e categoria sono scansionabili?

- I tuoi URL con parametri di ordinamento e filtri sono gestiti correttamente?

- Le tue risorse CSS e JavaScript sono accessibili? (Google ha bisogno di leggerle per capire il tuo design)

- La tua sitemap è dichiarata in fondo al file?

Un audit onesto richiede 2 ore su un sito standard. Su un e-commerce con 5.000 referenze, prevedi una giornata.

Il nuovo report “Schede Prodotto” in Google Search Console: cosa cambia per gli e-commerce

Questa è la vera novità che dovrebbe far reagire tutti i proprietari di negozi online.

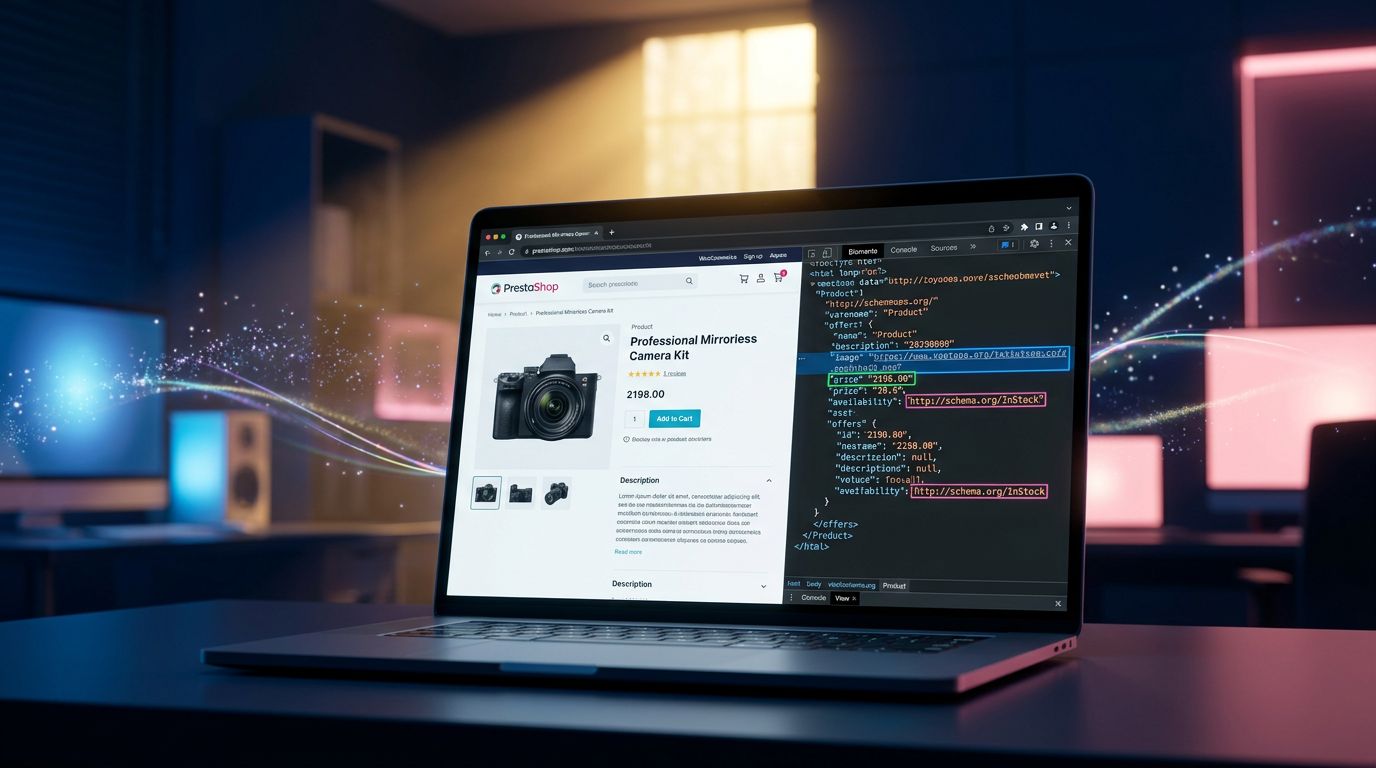

Google ha lanciato un report dedicato ai Merchant Listings — le schede prodotto arricchite che appaiono in Google Shopping, i risultati di ricerca con prezzo e disponibilità, e i pannelli di conoscenza prodotti. Questo report è ora direttamente accessibile in Search Console, con un livello di dettaglio senza precedenti.

“I dati strutturati sono il linguaggio che usi per parlare direttamente a Google. Se la tua grammatica è sbagliata, Google non capisce — e i tuoi prodotti non appaiono.”

Concretamente, questo report ti fornisce:

La copertura reale delle tue schede prodotto. Quanti dei tuoi prodotti sono idonei alla visualizzazione arricchita? Quanti vengono effettivamente visualizzati? Il divario tra i due è il tuo margine di miglioramento immediato.

Gli errori di dati strutturati per tipo. Prezzo mancante, disponibilità non specificata, immagine non conforme agli standard di Google — ogni errore è categorizzato. Sai esattamente cosa correggere e in quale ordine.

La distinzione tra errori bloccanti e avvisi. Un errore bloccante = la tua scheda non appare. Un avviso = appare, ma sotto-ottimizzata. La distinzione è importante per stabilire le priorità delle tue azioni.

Gli errori più frequenti che vediamo nei negozi online

Negli e-commerce che auditiamo regolarmente, tre problemi emergono sistematicamente:

1. Il prezzo assente o mal formattato

Google richiede un prezzo con valuta esplicita nel markup Schema.org. "price": "29.90" senza "priceCurrency": "EUR"? Scheda non valida. È un errore banale, ma riguarda facilmente dal 20 al 30% dei prodotti nei negozi allestiti rapidamente.

2. La disponibilità mai aggiornata

Il campo availability in Schema.org deve riflettere lo stato reale dello stock. Un prodotto contrassegnato come InStock quando è esaurito da 3 settimane? Google lo rileva, degrada la tua scheda e può penalizzare la fiducia globale accordata al tuo dominio.

3. Le immagini non conformi

Google Shopping ha requisiti precisi: immagine principale su sfondo bianco o neutro, minimo 250x250 pixel, nessun testo promozionale sovrapposto. Molti negozi usano le loro immagini “marketing” con banner “PROMO -20%” — e si ritrovano con schede bloccate senza capirne il motivo.

Dati strutturati: l’investimento tecnico che ripaga davvero

Ecco dove diventa interessante.

I dati strutturati non sono un dettaglio tecnico riservato alle grandi aziende. Sono la leva più sottosfruttata dalle PMI e-commerce. E il report Merchant Listings di Search Console ha appena reso questo investimento molto più misurabile.

Prima di questo report, avevi una vaga idea di se i tuoi prodotti apparivano in Google Shopping. Ora hai i dati prodotto per prodotto, errore per errore. È la differenza tra “penso che il mio markup sia corretto” e “Google mi dice esattamente cosa non va in 47 dei miei 312 prodotti”.

Quello che abbiamo osservato nei progetti recenti: correggere gli errori di dati strutturati su un negozio PrestaShop di medie dimensioni genera in media dal 15 al 25% di impressioni aggiuntive nei risultati arricchiti nelle 6-8 settimane successive. Nessuna magia — solo precisione tecnica. Queste ottimizzazioni si inseriscono in un approccio globale di posizionamento web che implementiamo per i nostri clienti.

“Il SEO nel 2026 è al 40% contenuto e al 60% precisione tecnica. La maggior parte delle agenzie vende il contenuto e trascura la tecnica.”

La corretta implementazione del markup Schema.org Product con tutti i campi richiesti (nome, descrizione, prezzo, valuta, disponibilità, immagine, marca, GTIN se disponibile) richiede da 1 a 3 giorni a seconda della complessità del tuo catalogo e della piattaforma. Su PrestaShop esistono moduli. Su WooCommerce anche. Ma la loro configurazione predefinita è raramente ottimale — occorre verificarla e adattarla.

Cosa implica concretamente per la tua strategia SEO

Questi due sviluppi — il rigore crescente su robots.txt e il nuovo report Merchant Listings — indicano la stessa direzione.

Google vuole precisione. Non approssimazione.

I siti che ne trarranno vantaggio sono quelli che trattano il SEO tecnico come un cantiere continuo, non come una casella da spuntare una volta all’anno. Ecco cosa implica concretamente:

Un audit robots.txt almeno una volta all’anno, e ad ogni restyling o migrazione. Sono 2 ore di lavoro che possono evitare mesi di perdita di traffico.

Un monitoraggio mensile del report Merchant Listings se hai un negozio online. Gli errori si accumulano progressivamente — un nuovo prodotto mal configurato, un aggiornamento di plugin che rompe il markup, un cambio di stock non riflesso. Uno sguardo regolare è sufficiente per correggerli prima che impattino sulla tua visibilità.

Un markup Schema.org mantenuto, non solo installato. L’errore classico: installi un plugin di dati strutturati, lo validi una volta in Google Rich Results Test, e non ci torni più. Però il catalogo evolve, i prezzi cambiano, lo stock si muove. Il markup deve seguire.

Un coordinamento tra il tuo team tecnico e il tuo team marketing. Quante volte vediamo campagne prodotto lanciate senza che nessuno abbia verificato se le schede corrispondenti siano correttamente marcate? Il report Merchant Listings deve diventare uno strumento condiviso, non un report tecnico isolato. Per una visione completa delle basi SEO da padroneggiare, la nostra guida al SEO tecnico dettaglia ogni livello da auditare.

3 azioni da mettere in atto questa settimana

Nessuna lista interminabile. Tre azioni concrete, in ordine di priorità:

Azione 1 — Testa il tuo robots.txt adesso. Vai su Google Search Console > Impostazioni > Robots.txt. Testa i tuoi 10 URL più importanti. Se uno di essi è bloccato senza motivo valido, è un’urgenza.

Azione 2 — Apri il report Merchant Listings se hai un negozio. Search Console > Esperienze > Schede Prodotto. Guarda il tuo tasso di copertura e l’elenco degli errori bloccanti. Se non hai ancora attivato il monitoraggio dei dati strutturati di prodotto, è il momento.

Azione 3 — Valida il tuo markup Schema.org su 5 pagine prodotto rappresentative. Usa lo strumento di test dei risultati avanzati di Google. Cinque minuti per pagina. Saprai esattamente dove sei.

Conclusione: il SEO tecnico non è più opzionale

Le PMI e-commerce che avranno successo nel 2026 non saranno necessariamente quelle con il budget pubblicitario più alto. Saranno quelle il cui sito è tecnicamente impeccabile — perché Google dà loro accesso ai formati di visualizzazione arricchita che i loro concorrenti perdono per negligenza.

Il robots.txt, i dati strutturati, il report Merchant Listings: non sono argomenti glamour. Ma sono leve misurabili, azionabili, con un ROI documentabile.

In GDM-Pixel, questo è esattamente il tipo di audit che realizziamo prima di toccare qualsiasi altra cosa su un sito. Perché abbiamo imparato a nostre spese che un bel sito mal configurato tecnicamente è un investimento che dorme.

Vuoi sapere a che punto è il tuo sito su questi aspetti? Facciamo una diagnosi tecnica in 48 ore. Nessun report illeggibile di 80 pagine — un elenco di azioni prioritizzate con l’impatto stimato sulla tua visibilità. Contattaci e lo valutiamo insieme.